Ludzie przeciw technologii. Jak internet zabija demokrację (i jak ją możemy ocalić) ebook

Jamie Bartlett

31,00 zł

Dowiedz się więcej.

- Wydawca: Sonia Draga

- Kategoria: Literatura popularnonaukowa•Nauki humanistyczne

- Język: polski

Autor dowodzi, że dalszy rozwój cyfrowych narzędzi komunikacyjnych – technologii – jest nie do pogodzenia z dalszym trwaniem liberalnych instytucji – demokracji. Demokracja liberalna wykształciła się w czasach analogowych, więc do analogowej rzeczywistości były przystosowane jej główne założenia i narzędzia do zarządzania kryzysem. W epoce cyfrowej, gdy koncepcje mediów, obywatelstwa, sfery publicznej i demokratycznej wspólnoty gwałtownie ewoluują i zmieniają swój sens, demokracja, jaką znamy, nie posiada już zdolności adaptacji. Albo więc demokracja „dogoni” cyfrową zmianę, a odpowiedzialne społeczeństwo w porę wykształci obywatelskie nawyki na miarę nowej epoki, albo czekają nas rządy technokratycznych despotów przy wsparciu aroganckiej kasty innowatorów z Doliny Krzemowej, którzy wejdą w rolę sędziów i kapłanów nowego porządku. Tak czy inaczej: „analogowa” demokracja się kończy. Czy uda się ją uratować? Ta książka nie mogła ukazać się w lepszym momencie, czyli dobie ujawnionej afery z Cambridge Analytica – „The Financial Times”

Ebooka przeczytasz w aplikacjach Legimi lub dowolnej aplikacji obsługującej format:

Liczba stron: 230

Rok wydania: 2019

Popularność

Podobne

Tytuł oryginału:

The People vs Tech: How the Internet is Killing Democracy(and How We Save It)

Copyright © Jamie Bartlett 2018

Copyright © 2019 for the Polish edition by Wydawnictwo Sonia Draga

Translation copyright © 2018, by Krzysztof Umiński

(under exclusive license to Wydawnictwo Sonia Draga)

Projekt okładki: Tomasz Majewski

Zdjęcie autora: © Pelle Sjoden

Redakcja: Kacper Kaczmarczyk / Słowne Babki

Korekta: Lena Marciniak-Cąkała, Lidia Ścibek / Słowne Babki

ISBN: 978-83-8110-810-2

Wszelkie prawa zastrzeżone. Nieautoryzowane rozpowszechnianie całości lub fragmentu niniejszej publikacji w jakiejkolwiek postaci jest zabronione i wiąże się z sankcjami karnymi.

Książka, którą nabyłeś, jest dziełem twórcy i wydawcy. Prosimy, abyś przestrzegał praw, jakie im przysługują. Jej zawartość możesz udostępnić nieodpłatnie osobom bliskim lub osobiście znanym. Ale nie publikuj jej w internecie. Jeśli cytujesz jej fragmenty, nie zmieniaj ich treści i koniecznie zaznacz, czyje to dzieło. A kopiując ją, rób to jedynie na użytek osobisty.

Szanujmy cudzą własność i prawo!

Polska Izba Książki

Więcej o prawie autorskim na www.legalnakultura.pl

WYDAWNICTWO SONIA DRAGA Sp. z o.o.

ul. Fitelberga 1, 40-588 Katowice

tel. 32 782 64 77, fax 32 253 77 28

e-mail:[email protected]

www.soniadraga.pl

www.postfactum.com.pl

www.facebook.com/PostFactumSoniaDraga

www.facebook.com/wydawnictwoSoniaDraga

E-wydanie 2019

Skład wersji elektronicznej:

konwersja.virtualo.pl

Wprowadzenie

W najbliższych latach albo technologia zniszczy znane nam formy demokracji i ładu społecznego, albo też władze polityczne okiełznają cyfrowy świat. Dziś coraz wyraźniej widzimy, że technologia zwycięża, druzgocząc osłabionego przeciwnika. Niniejsza książka tłumaczy, dlaczego tak się dzieje i w jaki sposób wciąż możemy odwrócić bieg wydarzeń.

Przez „technologię” nie rozumiem, rzecz jasna, ogółu technologii. Słowo to (podobnie jak „demokracja”) powstało ze złożenia dwóch greckich wyrazów – techne oznaczającego „umiejętność”, orazlogos oznaczającego „rozum” – a co za tym idzie obejmuje swym znaczeniem prawie cały nowoczesny świat1. Nie mówię więc o tokarce, krośnie mechanicznym, samochodzie, aparacie do rezonansu magnetycznego czy o myśliwcu F16. Ściśle rzecz biorąc, interesują mnie technologie cyfrowe kojarzone z Doliną Krzemową – platformy mediów społecznościowych, big data, technologie mobilne i sztuczna inteligencja – które coraz potężniej oddziałują na życie gospodarcze, polityczne i społeczne.

Nie ulega wątpliwości, że dzięki tym technologiom jesteśmy w ogólności lepiej zorientowani, zamożniejsi i poniekąd szczęśliwsi. W końcu technologia zwykle poszerza ludzkie możliwości, otwiera nowe horyzonty, podnosi wydajność. Nie znaczy to jednak koniecznie, że jest dobra dla demokracji. W zamian za niewątpliwe korzyści z postępu technologicznego oraz za większą wolność osobistą pozwoliliśmy, by erozji uległo wiele kluczowych składników sprawnego systemu politycznego, takich jak: kontrola, suwerenność parlamentarna, równość ekonomiczna, społeczeństwo obywatelskie i świadoma postawa obywatelska. A przecież rewolucja technologiczna dopiero się zaczyna. Jak pokażę, w najbliższych latach dokona się dalszy radykalny postęp w dziedzinie technologii cyfrowych. Jeśli utrzyma się aktualna tendencja, to w ciągu jednego lub dwóch pokoleń sprzeczności między techniką a demokracją zostaną zniesione.

Przypadek demokracji jest osobliwy: choć niemal każdy uważa ją za wartość, to nie sposób uzgodnić jej wspólną definicję. Politolog Bernard Crick stwierdził swego czasu, że prawdziwy sens tego słowa „przechowuje się gdzieś w niebie”. Ogólnie rzecz biorąc, demokracja to z jednej strony zasada, która mówi nam, jak zarządzać zbiorowością, z drugiej zaś zestaw instytucji, dzięki którym władzę ustanawia się głosem ludu. Szczegóły jej działania różnią się w zależności od miejsca i czasu, lecz jej najsprawniejszą i najpopularniejszą wersją jest bez dwóch zdań n o w o c z e s n a l i b e r a l n a d e m o k r a c j a p r z e d s t a w i c i e l s k a. Od tej pory ilekroć piszę „demokracja”, mam na myśli ten właśnie model (a przyglądam się wyłącznie dojrzałym demokracjom Zachodu; rozszerzenie tej perspektywy wyznaczyłoby zupełnie inny temat). Demokracja w tej postaci zwykle polega na tym, że lud wybiera swoich przedstawicieli, by decydowali w jego imieniu, oraz że istnieje szereg powiązanych instytucji, dzięki którym całość działa. Do instytucji tych zalicza się regularne wybory, zdrowe społeczeństwo obywatelskie, rozmaite swobody osobiste, dobrze zorganizowane partie polityczne, skuteczną biurokrację oraz wolne i czujne media. Nawet to nie wystarczy – demokracje potrzebują oddanych obywateli, którzy wierzą w ogólniejsze ideały demokratyczne, takie jak dystrybucja władzy, prawa obywatelskie, kompromis i rzetelna debata. Wszystkie stabilne demokracje łączą w sobie niemal każdy z tych elementów.

Nie jest to kolejna rozdęta do rozmiarów książki skarga na pazernych kapitalistów poprzebieranych za fajnych chłopaków z kompami ani też umoralniająca powiastka o zachłanności międzynarodowych koncernów. Przez lata demokracja rozprawiła się z niejednym rekinem biznesu. Jakkolwiek istnieje niewątpliwa sprzeczność pomiędzy minimalizacją podatków a głoszeniem, że wzmacnia się społeczeństwo, to taka postawa niekoniecznie świadczy o hipokryzji. Co więcej, na pierwszy rzut oka technologia jest dla demokracji dobrodziejstwem. Bez wątpienia ulepsza i poszerza sferę ludzkiej wolności, a do tego zapewnia dostęp do nowych informacji i idei. Daje głos grupom, które wcześniej były niesłyszane, a także dostarcza nowych sposobów gromadzenia wiedzy i samoorganizacji. To również są elementy zdrowego społeczeństwa demokratycznego.

Niemniej na głębszym poziomie te dwa wielkie systemy – technologia i demokracja – pozostają w ostrym konflikcie. Każdy z nich jest wytworem całkowicie odmiennej epoki, każdy działa wedle innych reguł i zasad. Demokratyczna machina powstała w dobie państwa narodowego, hierarchii, autorytetów i uprzemysłowionej gospodarki. Zasadnicze cechy technologii cyfrowej pasują do tego modelu jak pięść do nosa: jest ona ageograficzna, zdecentralizowana, opiera się na danych, podlega efektowi sieciowemu i gwałtownym wzrostom. Mówiąc najprościej: demokracji nie stworzono z myślą o czymś takim. Trudno kogokolwiek o to obwiniać, nawet Marka Zuckerberga.

Nawiasem mówiąc, nie jestem w tych poglądach szczególnie osamotniony. Wielu pionierów cyfrowego świata również dostrzegało rozdźwięk pomiędzy „cyberprzestrzenią”, jak ją nazywali, a światem fizycznym. To napięcie świetnie oddaje cytowana po wielekroć Deklaracja niepodległości cyberprzestrzeni napisana przez Johna Perry’ego Barlowa: „Rządy czerpią swoją sprawiedliwą władzę ze zgody rządzonych. Wy nie prosiliście nas o zgodę ani jej nie otrzymaliście. Nie zapraszaliśmy was. Nie znacie nas ani naszego świata (…). Wasze prawne koncepcje własności, wypowiedzi, tożsamości, przemieszczania się i konteksty nie odnoszą się do nas. Ufundowane są na pojęciu materii, a tutaj nie ma materii”. Jest to porywające credo wolności dawanej przez Internet, które do dziś porusza entuzjastów cyfrowego świata. Tak się jednak składa, że demokracja jest ufundowana na materii, a oprócz tego na prawnych koncepcjach własności, wypowiedzi, tożsamości i przemieszczania się. Jeśli poskrobiemy mocniej, zobaczymy, że pod powłoczką korporacyjnych frazesów z Doliny Krzemowej o łączeniu ludzi, sieciach relacji i globalnych wspólnotach ciągle bije antydemokratyczny nurt.

Na następnych stronach rozwinę tezę, że istnieje sześć filarów, dzięki którym demokracja funkcjonuje nie tylko jako abstrakcyjna koncepcja, ale także jako skuteczny system zbiorowego samorządu, który obywatele darzą zaufaniem i wsparciem. Te filary to:

AKTYWNI OBYWATELE: czujni, niezależnie myślący obywatele, którzy są zdolni dokonywać istotnych osądów moralnych.

WSPÓLNA KULTURA: demokratyczna kultura ufundowana na podzielanej wizji rzeczywistości, wspólnej tożsamości i duchu kompromisu.

WOLNE WYBORY: wybory wolne, sprawiedliwe i traktowane z zaufaniem.

RÓWNOŚĆ UDZIAŁOWCÓW: funkcjonalny poziom równości społecznej; rozbudowana klasa średnia.

GOSPODARKA OPARTA NA KONKURENCJI I WOLNOŚĆ OBYWATELSKA: gospodarka oparta na konkurencji i niezależne społeczeństwo obywatelskie.

ZAUFANIE DO WŁADZ: suwerenna władza, która ma moc realizowania woli ludu, a zarazem zachowuje jego zaufanie i jest przezeń rozliczana.

W dalszych rozdziałach przyjrzę się powyższym filarom i wyjaśnię, w jaki sposób i dlaczego są one zagrożone. Niektóre już w tej chwili są w opałach. W wypadku innych wybiegnę nieco w przyszłość, by pokazać, że dla nich także nadejdą niebawem ciężkie czasy. Przykłady można mnożyć: rozwój inteligentnych urządzeń podkopuje naszą zdolność do wydawania sądów moralnych, odradza się plemienny model polityki, widmo masowego bezrobocia narasta, w miarę jak hiperwydajne roboty zastępują ludzi, którzy potrzebują przerw w pracy – demokracja zbiera ciosy ze wszystkich stron. Część tych niebezpieczeństw dobrze znamy. Agresywna polityka, bezrobocie czy obywatelska apatia nie należą do zjawisk szczególnie nowych, choć przybierają nieznane dotąd formy. Inne zagrożenia są jednak absolutną nowością: inteligentne urządzenia mogą zastąpić rozmaitych liderów i przekształcić polityczne procesy decyzyjne w sposób, o jakim się nam nie śniło. Niewidzialne algorytmy wytwarzają nowe, nieuchwytne źródła władzy i niesprawiedliwości. Im bardziej świat podłącza się do sieci, tym łatwiej małym grupkom awanturników wyrządzać kolosalne szkody i dokonywać spustoszeń, często całkowicie poza zasięgiem prawa. Nie mamy pojęcia, jak zaradzić tym problemom.

W ostatnim rozdziale zaproponuję wizję przyszłości, jaka może nadejść, jeśli sprawy dalej będą się toczyć obecnym torem. Wbrew powszechnie hołubionej analogii nie czeka nas powtórka z lat trzydziestych zeszłego stulecia. Sądzę raczej, że demokracja znajdzie nowe, zaskakujące formy upadku. Bać się należy dystopii, która majaczy na horyzoncie: to naskórkowa demokracja sterowana przez inteligentne maszyny oraz nową elitę „postępowych”, lecz despotycznych technokratów. A najgorsze, że wielu ludzi będzie ten system woleć od obecnego, ponieważ zapewni im większy dobrobyt i większe bezpieczeństwo.

Ale nie powinniśmy jeszcze brać się do niszczenia maszyn. Choćby dlatego że trwa właśnie technologiczny wyścig zbrojeń, w którym demokratyczne społeczeństwa mierzą się ze swoimi odpowiednikami z Rosji i Chin. Ważne, by demokracje ten wyścig wygrały. A jeśli rewolucję technologiczną poddać demokratycznej kontroli, to może ona przynieść naszym społeczeństwom setki korzystnych zmian. Niemniej zarówno technika, jak i demokracja muszą ulec radykalnemu przeistoczeniu. W zakończeniu książki zamieszczam dwadzieścia postulatów dotyczących tego, jak demokracja – a co ważniejsze: każdy z nas – musi się zmienić, żeby przetrwać w epoce, w której zewsząd otaczają nas inteligentne urządzenia i big data, a sfera publiczna ma postać cyfrową.

Całkiem możliwe, że na tym etapie uznaliście mnie za hipokrytę, który swoją książkę napisał zapewne na laptopie, informacji szukał w Google’u, o dacie premiery poinformuje na Twitterze i liczy, że tytuł dobrze się sprzeda na Amazonie. To wszystko prawda! Podobnie jak wielu z nas, równocześnie kocham technologie, o których piszę, nienawidzę ich i jestem od nich zależny. Mało tego, od dekady pracuję w awangardzie polityki i technologii, w czołowym brytyjskim think tanku Demos. Odkąd dołączyłem do niego w 2008 roku, pisywałem broszury o tym, jak to technika cyfrowa tchnie nowe życie w nasz rozpaczliwie zmurszały system polityczny. Z biegiem lat mój optymizm przeszedł w realizm, a następnie w nerwowość. Obecnie zbliża się do stanu łagodnej paniki. Nadal wierzę, że technologia może być motorem zmiany na lepsze w naszej polityce – i że wielu technologicznych gigantów podziela tę nadzieję – lecz po raz pierwszy szczerze niepokoję się o długoterminowe perspektywy systemu, który Winston Churchill w swojej słynnej sentencji nazwał „najgorszym rodzajem rządów oprócz wszystkich innych, które dotąd wypróbowano”.

Wielcy pionierzy technologii nie podzielają, rzecz jasna, tej troski, gorąco bowiem wierzą w promienistą technoutopię, a także w to, że są w stanie nas wszystkich ku niej poprowadzić. Miałem szczęście robić wywiady z niektórymi spośród nich, spędziłem także sporo czasu w Dolinie Krzemowej bądź też w towarzystwie osób, które należą do technologicznego światka. Z moich doświadczeń wynika, że rzadko są to źli ludzie i że zazwyczaj wierzą oni w emancypacyjną moc technologii cyfrowej. Wiele z ich wynalazków jest wspaniałych. Lecz właśnie dlatego mogą się okazać tym niebezpieczniejsze. Niczym osiemnastowieczni rewolucjoniści, którzy dufali, że mogą zbudować świat oparty na abstrakcyjnych ideach w rodzaju równości, utopiści świeżej daty z zapałem obmyślają społeczeństwo rządzone przez łączność, sieci, platformy i dane. Demokracja (a skądinąd i świat) nie działa w ten sposób – jest powolna, refleksyjna i zakorzeniona w materii. Raczej analogowa niż cyfrowa. A każda wizja przyszłości, która idzie na przekór realiom ludzkiego życia i ludzkich pragnień, musi się skończyć katastrofą.

Rozdział 1: Nowy panoptykonCo potęga danych robi z naszą wolną wolą

Żyjemy w ogromnym reklamowym panoptykonie, który utrzymuje nas w stanie zależności od urządzeń elektronicznych. Ten system gromadzenia danych i przewidywania stanowi najnowsze narzędzie w długiej historii działań mających nas kontrolować. Z dnia na dzień zabiegi te są coraz doskonalsze, a ich skutki mogą być poważne: manipulacja, niepohamowane rozproszenie uwagi oraz stopniowe ograniczanie wolnego wyboru i samorządności.

Mity założycielskie są niezwykle ważne dla przedsiębiorstw. Kształtują to, jak firma widzi sama siebie i jak chce być postrzegana przez innych. Mit założycielski mediów społecznościowych głosi, że są spuścizną „kultury hakerów” – siedziba Facebooka znajduje się przy ulicy Hakerów 1 – a to łączy je z buntownikami takimi jak Kevin Mitnick, który w latach osiemdziesiątych dwudziestego wieku łamał zabezpieczenia sieci telefonicznych, z nienawidzącymi biurokracji komputerowcami z kręgu Homebrew Club, a sięgając dalej wstecz – z geniuszami matematycznymi pokroju Alana Turinga czy Ady Lovelace.

Tymczasem Google, Snapchat, Twitter, Instagram, Facebook i spółka od dawna nie zajmują się tylko wytwarzaniem technologii. Są to również firmy reklamowe. Blisko 90 procent dochodów Facebooka i Google’a pochodzi ze sprzedaży reklam. W zasadzie cała branża mediów społecznościowych opiera się na świadczeniu bezpłatnych usług w zamian za dane, z których firmy te następnie korzystają, żeby adresować do nas reklamy2.

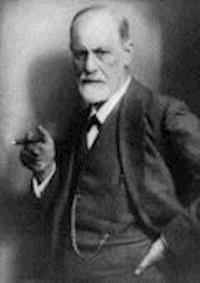

Stan ten przywodzi na myśl bardzo odmienne i znacznie mniej chlubne koneksje: z reklamiarzami w garniturach i psychologami, którzy przez dziesięciolecia w pocie czoła starali się odgadnąć, jak człowiek podejmuje decyzje, i odnaleźć przycisk „kup!” skryty gdzieś w naszym płacie czołowym. Bardziej wyrazistą opowieść założycielską odnajdziemy we wczesnych latach amerykańskiej psychologii, która narodziła się jako poważna dyscyplina akademicka sto lat temu, wraz z początkami masowej kultury konsumpcyjnej. W Europie, a zwłaszcza w Niemczech, psychologia rozwijała się już od pewnego czasu, do Stanów zaś importowano ją przed pierwszą wojną światową. Wszelako amerykańska odmiana psychologii porzuciła europejską fascynację filozoficznymi abstrakcjami w rodzaju „wolnej woli” i „umysłu”. Pod wpływem prekursorów, takich jak James Cattell i Harlow Gale, zaczęła natomiast badać, jak uczynić ludzki proces decyzyjny przedmiotem twardej nauki, którą można będzie wykorzystać w biznesie[1].

W 1915 roku John Watson został przewodniczącym Amerykańskiego Stowarzyszenia Psychologicznego. Watson przekonywał, że zasadniczo każde ludzkie zachowanie jest pochodną mierzalnych bodźców zewnętrznych, a zatem można je zrozumieć i kontrolować poprzez badanie i eksperyment. Doktrynę tę, która zyskała rozgłos pod nazwą behawioryzmu, spopularyzowały następnie prace B.F. Skinnera. Dla firm marzących o skutecznej sprzedaży wizja uległej ludzkości miała nieodparty urok i behawioryzm rozprzestrzenił się po korporacyjnym świecie jak wirus. Przez kilka lat przedsiębiorstwa – dopingowane przez Watsona i innych – sądziły, że sprawują nieomal boską władzę nad pragnieniami, nadziejami, lękami i, oczywiście, zakupami. Behawioryzm wyszedł nieco z mody w latach dwudziestych ubiegłego wieku wraz z nadejściem statystycznych badań rynku (które w odróżnieniu od behawioryzmu wymagały tego, by zadawać ludziom jakieś pytania). Niemniej oba trendy – behawioryzm i badania rynku – zwiastowały bardziej naukowe podejście do reklamy, które towarzyszy nam do dziś.

Gdyby John Watson żył dzisiaj, pracowałby jako chief nudger (dosłownie: naczelny szturchacz – czyli specjalista od wpływania na ludzkie zachowania) w Google’u, Amazonie albo Facebooku. Platformy mediów społecznościowych to najnowszy wariant snu behawiorysty o zarządzaniu społeczeństwem za pomocą naukowej obserwacji umysłu prowadzonej za pośrednictwem pełnego obiegu informacyjnego: testujemy model na ludziach, dostajemy informację zwrotną, modyfikujemy produkt. Yuval Noah Harari zaproponował własne określenie dla tej koncepcji: „dataizm”. Jest to koncepcja głosząca, że matematyczne prawa dotyczące danych odnoszą się zarówno do ludzi, jak i do maszyn. Pogląd, że przy dostatecznej ilości danych można rozwikłać zagadki ludzkiego umysłu i na ten umysł wpływać, jest dziś zapewne dominującą filozofią w Dolinie Krzemowej. W wielokrotnie przytaczanym eseju z 2008 roku ówczesny redaktor naczelny „Wired” Chris Anderson ogłaszał „koniec teorii”. Teraz, gdy mamy big data – przekonywał – teorie naukowe straciły rację bytu. „Precz z wszelkimi teoriami na temat ludzkiego zachowania… Kto wie, dlaczego ludzie robią to, co robią? Ważne, że to robią, a my możemy śledzić i mierzyć ten proces z niespotykaną dotąd precyzją”. Google’owscy inżynierowie nie snują teorii i spekulacji o tym, dlaczego ludzie odwiedzają jedną stronę częściej niż drugą – po prostu sprawdzają różne schematy i patrzą, co działa.

W czeluściach każdej firmy technologicznej o efektownym wizerunku najtęższe mózgi świata pobierają astronomiczne pensje za odgadywanie, czemu na coś klikamy, i skłanianie nas, byśmy klikali więcej. Choć w ostatecznym rozrachunku sukces Facebooka wynika z ludzkiej mentalności (ludzie to istoty, które uwielbiają się naśladować i obserwować, Facebook zaś jest najpotężniejszym w dziejach systemem, który pozwala widzieć i być widzianym), to na dodatek wykorzystano tu każdy możliwy patent, żeby utrzymać naszą uwagę. Niczego nie pozostawiono przypadkowi, ponieważ nawet najmniejsza poprawka może być warta majątek. Firmy technologiczne przeprowadzają tysiące testów z udziałem milionów użytkowników – retuszując tła, kolory, obrazy, tony, kroje pisma i dźwięki – a wszystko po to, by użytkownik czuł się jak najlepiej i klikał jak najwięcej[2]. Stronę główną Facebooka starannie zaprojektowano tak, by wypełniały ją dobrze widoczne liczby – polubień, znajomych, postów, interakcji i nowych wiadomości (zawsze na czerwono! Pilne!). Autoodtwarzanie, niekończące się przewijanie i oś czasu zostały skonstruowane tak, by utrzymywać naszą uwagę[3].

Zabiegi te niewątpliwie działają. Są nas dzisiaj całe tabuny – armia zombie ze wzrokiem wbitym w wyświetlacz i gadających z jakimś odległym, bezcielesnym awatarem zamiast z kimś, kto siedzi obok nas. Jak wielu innych ludzi, uważam siebie nie tyle za uczestnika, ile za obserwatora tych przemian, toteż w zeszłym roku ściągnąłem aplikację RealizD, która sprawdza, jak często i na ile czasu bierzemy do ręki telefon.

Poniedziałek, 27 listopada: 103 kontakty, 5 godzin 40 minut.

Wtorek, 28 listopada: 90 kontaktów, 4 godziny 29 minut.

Środa, 29 listopada: 63 kontakty, 6 godzin 1 minuta.

Czwartek, 30 listopada: 58 kontaktów, 3 godziny 42 minuty.

Piątek, 1 grudnia: 71 kontaktów, 4 godziny 12 minut.

W świetle tych wyników biorę telefon do ręki i coś sprawdzam średnio siedemdziesiąt siedem razy dziennie. Po odjęciu snu daje to z grubsza jeden kontakt na dwanaście minut. Nie jestem sam. Zdaniem Adama Altera nałogi alkoholowy i nikotynowy oddają pole cyfrowym uzależnieniom – epidemii sprawdzania, wyjmowania, przesuwania palcem i klikania[4]. Wiele osób twierdzi dziś, że są uzależnione od Internetu i nie mogłyby żyć bez swoich telefonów[5]. Niektórzy badacze akademiccy sądzą wręcz, że spadek spożycia alkoholu i narkotyków wśród młodzieży może wynikać z tego, że młodzi uzyskują wyrzuty dopaminy dzięki piknięciom swoich urządzeń3. „W 2004 roku Facebook bawił – pisze Alter. – W 2016 uzależnia”[6]. Nie jest to przypadek. Witajcie w ekonomii uwagi.

Przyczyną, dla której sprawdzam swój telefon co około dwunastu minut, jest stała, lecz niespójna informacja zwrotna. Badania pokazują, że istnieje silny związek między oczekiwaniem na informację a sterowanym przez mózg systemem nagradzania dopaminą oraz że uzależnienie osiąga najwyższy poziom, gdy stawka nagrody jest najbardziej zmienna[7]. Moją reakcję również zaprojektowano za pomocą „powiadomień push”, czyli piknięć i symboli, które wyskakują, by zawiadomić nas, że mamy coś nowego w skrzynce odbiorczej. Nie inaczej jest z wprowadzonym w 2009 roku przyciskiem „lubię”, wywodzącym się z – tak, to naprawdę istnieje – badań nad lubieniem, które od dawna wykazują, że emocja „lubię” jest najpotężniejszą kategorią w reklamie[8]. (Podobno Facebook początkowo chciał wprowadzić przycisk awesome – ‘czad’)[9]. Sean Parker, pierwszy prezes Facebooka, niedawno nazwał przycisk „lubię to” „sprzężeniem zwrotnym społecznego uznania (…). To typowy pomysł hakera takiego jak ja, ponieważ polega na wykorzystaniu ludzkiej słabości”. Dodał, że on, Mark Zuckerberg i pozostali zdawali sobie z tego sprawę, „a i tak w to weszli”[10].

Dane

Dla gigantów z branży mediów społecznościowych szczytem marzeń – podobnie jak dla wszelkich speców od reklamy – jest rozumieć was lepiej, niż sami siebie rozumiecie. Przewidywać, co zrobicie, powiecie, a nawet pomyślicie. Facebook nie zbiera informacji o was gwoli rozrywki, lecz po to, żeby wejść wam do głowy. Wiedza, którą ta firma zgromadziła na wasz temat – wyłącznie na podstawie niezliczonych godzin spędzonych przez was na jej stronie – zapełniłaby kilka segregatorów, a dotyczy spraw takich, jak: zainteresowania, wiek, znajomi, praca, zajęcia w czasie wolnym i wiele innych. Nie koniec na tym. Facebook współpracuje z dyskretnymi kolosami – „brokerami danych” w rodzaju Acxiomu dysponującego zbiorem danych o pięciuset milionach aktywnych konsumentów z całego świata, w którym to zbiorze na każdą osobę przypadają tysiące danych: są tam kwestie takie, jak: wiek, rasa, płeć, waga, wzrost, stan cywilny, wykształcenie, poglądy polityczne, nawyki zakupowe, problemy zdrowotne i wakacje, nierzadko podebrane z innych sklepów i rejestrów[11]. Dane te są analizowane i opatrywane odsyłaczami, a wyposażone w nie firmy mogą z jeszcze większą precyzją kierować reklamę do odbiorcy.

To zdumiewające, ale ten obłęd gromadzenia danych dopiero się rozkręca. Do 2020 roku w obiegu znajdzie się około pięćdziesięciu miliardów urządzeń z dostępem do Internetu – to czterokrotnie więcej niż teraz – a każde z nich zasysać będzie dane: samochody, lodówki, ubrania, znaki drogowe i książki. Twoja najdroższa córeczka bawi się lalką: obserwacja empiryczna! Twój partner lub partnerka słodzi herbatę: obserwacja! Nikt nie uchowa się przed tymi potworami i ich nienasyconym głodem danych. Google zaczął wysyłać fotografów od Street View do sklepów, biur i muzeów, żeby tworzyli trójwymiarowe modele wszystkich przestrzeni, do jakich moglibyście się wybrać. Inteligentne domy chcą znać waszą ulubioną temperaturę, wiedzieć, kiedy się myjecie, co gotujecie i ile śpicie. W niestrudzonej pogoni za danymi wszystko zostanie zebrane, przeanalizowane i porównane z wszystkim innym.

Ten natłok danych przekracza dziś znacznie ludzkie możliwości analizy, dlatego też algorytmy zajmują tak kluczowe miejsce we współczesnej gospodarce. Algorytm to prosta matematyczna formuła, zestaw instrukcji, które komputer wdraża, żeby wykonać dane polecenie. To tylko suchy opis – w istocie algorytm jest magicznym kluczem otwierającym wrota skarbca. Algorytmy filtrują, przewidują, zestawiają, nakierowują i zdobywają wiedzę. Już teraz waszym życiem sterują algorytmy, które decydują o wszystkim, od rekomendacji Amazona i waszego news feedu na Facebooku po wyniki, które wyskakują wam w Google’u. O sugestiach serwisów randkowych. O waszej trasie do pracy. O muzyce, której słuchacie. O agregatorach newsów. O waszych ubraniach.

Nowoczesne algorytmy operujące big data mają tę niepokojącą właściwość, że potrafią domyślić się na nasz temat rzeczy, o których sami nie wiemy. Ludzie są zwykle dość przewidywalni i przy stosownej porcji danych – nawet banalnych i nieistotnych okrawków typu jakich piosenek ktoś słucha – algorytmy mogą dowiedzieć się bardzo istotnych rzeczy na temat czyjejś osobowości.

W 2011 roku Michał Kosiński, psycholog pracujący wówczas na Uniwersytecie w Cambridge, stworzył internetową sondę, która badała cechy osobowościowe uczestników. Psychologowie od dziesiątków lat opracowują kwestionariusze służące określaniu osobowości4. Kosiński chciał zobaczyć, czy dzięki danym z Internetu można ustalić coś istotnego na temat osobowości danego człowieka bez uciekania się do ankiety; czy da się opracować profil psychologiczny jedynie na podstawie lajków z Facebooka. Kosiński i jego zespół ułożyli kilka testów osobowości i zamieścili je na Facebooku, zapraszając użytkowników do ich wypełniania. Ankieta rozniosła się jak wirus – bądź co bądź żyjemy w dobie narcyzmu – i wypełniły ją miliony internautów. Kosiński zestawił odpowiedzi udzielone przez uczestników z ich polubieniami z Facebooka i tym samym zbadał, jak jedne mają się do drugich. Na tej podstawie stworzył algorytm, który wyłącznie na podstawie lajków był w stanie odgadnąć wiele osobistych szczegółów na temat milionów użytkowników portalu spoza ankietowanej grupy. W 2013 roku Kosiński ogłosił wyniki i udowodnił, że łatwo dostępne cyfrowe rejestry zachowania można wykorzystać, by szybko i celnie określić czyjąś orientację seksualną, przynależność etniczną, przekonania religijne i polityczne, cechy charakteru, inteligencję, wiek i płeć, a także to, czy jest szczęśliwy, czy używa substancji uzależniających i czy jego rodzice się rozstali[12]5.

W 2017 roku odwiedziłem Michała Kosińskiego na Uniwersytecie Stanforda, na którym obecnie pracuje. Wielu uważa Stanforda za uniwersytet Doliny Krzemowej – leży nieopodal, a założyciele Cisco, Google’a, Hewletta-Packarda i Yahoo bez wyjątku ukończyli tę uczelnię. Michał, który wygląda o wiele za młodo na profesora, zabrał mnie do swojego gabinetu w Podyplomowej Szkole Biznesu (naturalnie) i zgodził się zademonstrować mi, jak działa jego system. Powierzyłem algorytmowi Michała około dwieście lajków ze swojego Facebooka: Rodzina Soprano, Kate Bush, Terminator 2, magazyn „The Spectator” i tym podobne. Algorytm wyruszył w świat na poszukiwanie osób o takich samych kombinacjach lub wariantach kombinacji. Małe kółko wirowało przez kilka sekund na ekranie, algorytm odprawiał swoje czary, a potem wyskoczyły wyniki: wolny od uprzedzeń, liberał, typ artystyczny, p o t w o r n i e inteligentny. Od razu widać, że to bardzo precyzyjny system – powiedziałem Michałowi. Algorytm ustalił także – co było o wiele dziwniejsze – że nie jestem religijny, ale gdybym był, to byłbym katolikiem. Sam bym tego lepiej nie ujął – od piątego do osiemnastego roku życia uczęszczałem do szkoły katolickiej i choć mam dla religii sporo sympatii, to nie chodzę do kościoła. Komputer odgadł też, że pracuję jako dziennikarz i żywo interesuję się historią – studiowałem historię i zrobiłem magisterium z metodologii badań historycznych.

Wszystko to wywnioskowano z facebookowych lajków, które nie mają nic wspólnego z moim pochodzeniem czy wychowaniem. „To jedna z rzeczy, których ludzie nie rozumieją na temat tych prognoz – powiedział mi Michał. – Jasne, jeśli polubisz Lady Gagę na Facebooku, to wiem, że lubisz Lady Gagę… Ale prawdziwa rewolucja polega na tym, że algorytm może wziąć twoje gusta muzyczne czy książkowe i z tych pozornie niewinnych informacji wysnuć wnioski na temat twojej religijności, potencjału przywódczego, poglądów politycznych, osobowości i tak dalej”. W rozdziale trzecim pokażę, jak partie polityczne mogą z tego korzystać w czasie wyborów. Niemniej gabinet Michała opuszczałem w poczuciu, że ten typ wnioskowania, choć szalenie interesujący, jest też nowym źródłem władzy, którą ledwo co rozumiemy, nie mówiąc o jej kontrolowaniu.

Logicznym punktem dojścia dataizmu jest zredukowanie każdego z nas do niepowtarzalnego, przewidywalnego zlepku danych, który można zasypać spersonalizowanymi treściami. Każdy, kto próbował uciąć sobie pogawędkę z czatbotem lub komu wyświetliła się reklama czegoś, co kupił chwilę wcześniej, wie, że technologiom tym daleko do doskonałości. Ale zmierza to w oczywistym kierunku i nietrudno wyobrazić sobie mechanizmy, za sprawą których pewnego dnia każdy wasz wybór będzie poddawany seriom impulsów, czerpiących wiedzę z otaczających was zewsząd doskonale wyskalowanych algorytmów. Wyobraźcie sobie tylko! Wstajecie wcześnie, świeżuteńcy, dzięki automatycznie nastawianemu budzikowi, który zna wasz rozkład zajęć i średni czas porannej krzątaniny z uwzględnieniem typowego ruchu drogowego. Po krótkiej analizie waszych parametrów zdrowotnych – i tysięcy osób do was podobnych – algorytm zaproponuje wam śniadanie ułożone na podstawie danych, zawierające kompozycję składników odżywczych idealnie dobranych do waszych potrzeb tego dnia (bonus: niewielki rabat składki na ubezpieczenie zdrowotne, jeśli z tej propozycji skorzystacie). Wskakujecie do samochodu bezzałogowego – właśnie wrócił z nocnej zmiany, podczas której zarabiał na was jako samodzielna taksówka. Odprężacie się jazdą, a osobisty robot asystent doradza wam, co powiedzieć na zebraniu dyrektorów handlowych, opierając się na poprzednim wystąpieniu i wiedzy o tym, kto będzie obecny. Zanim samochód porwie was z powrotem do domu…

Możliwości reklamowania są w takich warunkach ogromne – to jasne. Jeśli opuścicie się w diecie lub nawet pojawi się statystyczne prawdopodobieństwo wpadki, to wówczas – na podstawie analizy snu, jedzenia, doboru słów na Facebooku i tonu głosu – system wyświetli wam reklamę miejscowego klubu fitness. Osobisty robot asystent będzie mówić, czego potrzebujecie, dokładnie w chwili, gdy będziecie tego potrzebować, a wy nawet nie będziecie wiedzieć dlaczego.

Przypomina to odcinek Czarnego lustra Charliego Brookera, więc łatwo zapomnieć o zaletach takiej wizji. W Demos kieruję działem, który specjalizuje się w analizie big data. W naszej pracy odkrywamy nowe sposoby rozumienia trendów społecznych, chorób, terroryzmu i wielu innych zjawisk. Dane mogą pomóc obywatelom – i pomogą – w rozliczaniu rządzących dzięki udostępnianiu wiedzy o wynikach poszczególnych ministerstw. Nie ma innego wyjścia: pewnego dnia będziemy mieć osobiste roboty, które w naszym imieniu będą rozmawiać z robotami przedsiębiorstw (o kartach kredytowych, pożyczkach na samochód, emeryturach i inwestycjach)[14]. Z perspektywy użytkownika to same dobre wieści.

Niemniej cała sekwencja przebiegająca od zbierania danych przez analizę i prognozę aż po nakierowanie komunikatu stawia życie obywatela demokraty w obliczu trzech wyzwań. Po pierwsze, nasuwa się pytanie, czy ludzie wystawieni na bezustanne gromadzenie informacji oraz obserwację ze strony mediów społecznościowych mają szansę politycznie dojrzeć. Po drugie, istnieje niebezpieczeństwo, że powyższych narzędzi używa się, by nami manipulować, rozpraszać nas i na nas wpływać – a wszystko to niekoniecznie dla naszego dobra. Trzecia kwestia jest bardziej hipotetyczna i nieuchwytna: czy my sami w ogóle wierzymy w swoją zdolność do podejmowania ważnych wyborów moralnych. Przyjrzyjmy się po kolei tym zagadnieniom.

Życie pod mikroskopem

W 1890 roku w epokowym – i wciąż bardzo aktualnym – artykule wydrukowanym na łamach „Harvard Business Review” Samuel Warren i Louis Brandeis (w przyszłości obaj zostaną sędziami Sądu Najwyższego) zastanawiali się, czy wynalezienie kamery oznacza dla obywateli ryzyko nieustannego nadzoru. Zwracali uwagę, że nowa technologia często zmienia subtelne normy społeczne, toteż aby nadążyć za zmianą, potrzebne są czasem nowe prawa. Rzeczywistość pierwszych lat dziewiętnastego wieku była tak skomplikowana i intensywna – pisali Warren i Brandeis – że „samotność i prywatność stały się dla jednostki nieodzowne”. Autorzy przekonywali, że obywatele potrzebują prawa do tego, „by zostawić ich w spokoju”.

Od tamtej pory prawo do prywatności zostało włączone do kodeksów i podjęto liczne kroki, żeby chronić obywateli zarówno przed bezwzględnymi przedsiębiorstwami, jak i apodyktycznym państwem – jedne i drugie bowiem mają powody, by naruszać naszą sferę osobistą. Bez przepisów o prywatności – które pod względem rygoru różnią się ogromnie w poszczególnych krajach – żylibyśmy dzisiaj w świecie totalnej i bezustannej inwigilacji. Obawiam się, że w krajach, gdzie te prawa nie istnieją, podręczne urządzenia, „inteligentne domy” i urządzenia ze sztuczną inteligencją niemal na pewno przyczynią się do stworzenia rządowej kontroli o bezprecedensowym zasięgu[15]. Moje wątpliwości nie dotyczą jedynie oligarchii i autokracji. Również w wolnych społeczeństwach nigdy nie jesteśmy „zostawieni w spokoju”. Szał danych przysporzył nowych narzędzi nadzoru także władzom demokratycznym i większość stowarzyszeń na rzecz wolności obywatelskich niepokoi się, jak wpłynie to na debatę polityczną i aktywizm. Jak wiele innych osób, z rosnącym zatroskaniem czytam doniesienia o ludziach aresztowanych i oskarżonych za to, że powiedzieli coś, co było wprawdzie obraźliwe i nieprzyjemne – ale nic ponadto. Czasem agencje wywiadowcze nie muszą już was nawet szpiegować – wystarczy, że zgłoszą się do firm technologicznych i wyduszą z nich to, czego im potrzeba6.

Inne, dyskretniejsze niebezpieczeństwo wiąże się z nieustannym nadzorem i wymianą danych, które uprawia Mały Brat7. W osiemnastym wieku filozof Jeremy Bentham (o nim więcej za chwilę) wymyślił nowy rodzaj więzienia, który nazwał panoptykonem. Panoptykon został zaprojektowany w taki sposób, żeby jeden strażnik mógł nadzorować wszystkich więźniów naraz, a oni nie wiedzieli, kiedy są pod obserwacją. Już sama taka ewentualność – sądził Bentham – miała zagwarantować, że wszyscy będą się dobrze zachowywać. W naszym współczesnym panoptykonie nie ma jednego strażnika: każdy jest i obserwującym, i obserwowanym. Permanentna widoczność i monitorowanie wymuszają posłuch i uległość. Sytuacja, w której człowiek bez przerwy przebywa pod nadzorem, wiedząc, że jego wypowiedzi są gromadzone i udostępniane, wytwarza miękką, lecz bezustanną autocenzurę. Być może nie czujemy tego, gdy ktoś miota wyzwiska na Twitterze – ale na każdego rozjuszonego trolla przypadają setki cichych użytkowników, podglądaczy, którzy patrzą, lecz nie piszą, bojąc się wściekłej twitterowej tłuszczy, kolekcjonerów danych, wścibskiego pracodawcy lub zgrai zawodowych pieniaczy czyhających na okazję, by wpaść w złość.